Som uavhengig blogger i 2026 har jeg sett det samme spørsmålet dukke opp i kommentarfelt, på LinkedIn og i e-post fra lesere: Kan jeg stole på at en AI-detektor faktisk vet om teksten min er menneskelig? Svaret er verken et klart ja eller et klart nei. Det er et spørsmål om hvordan verktøyet er bygget, hva du bruker det til, og hvordan du tolker tallene på skjermen.

I denne artikkelen går jeg gjennom tillit og pålitelighet: når resultater gir mening, hvor de ofte feiler, og hvilke vaner som gjør deg tryggere – uansett om du er lærer, redaktør, student eller innholdsprodusent. Jeg avslutter med en ærlig sammenligning av fem kjente tjenester, inkludert én som i praksis er rettet mot norske tekster med egen modell og høy rapportert treffsikkerhet.

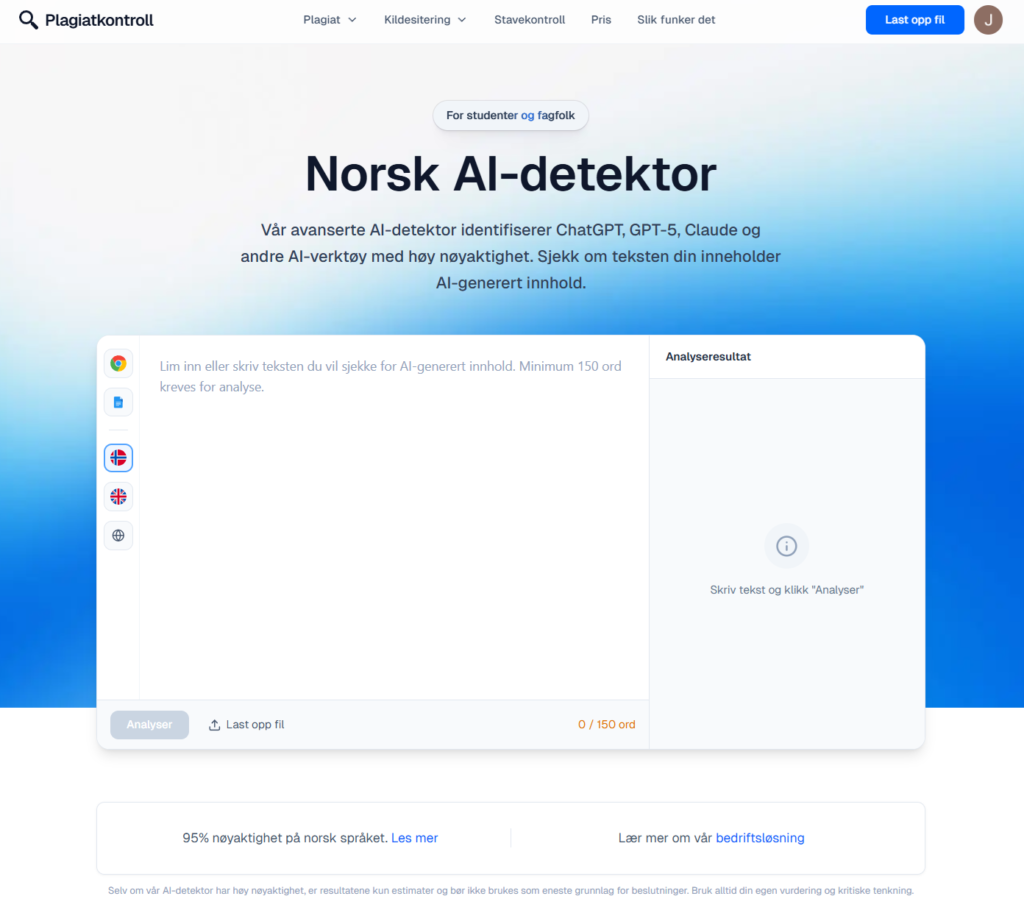

Plagiatkontroll.no

Hvorfor «nøyaktighet» er et vanskelig begrep

Når en leverandør sier at en ai detector har høy nøyaktighet, betyr det sjelden det samme som at den alltid har rett i ditt konkrete tilfelle. I praksis måler de fleste systemer sannsynlighet: teksten din ligner på mønstre modellen har sett i treningssett merket som «menneskelig» eller «maskinelt». Det er forskjell på statistikk på store mengder tekst og én enkelt avhandling eller bloggpost.

For deg som bruker verktøyet betyr dette tre ting du bør ha i bakhodet:

- Kontekst teller mer enn prosenttallet. En kort tekst, en uvanlig sjanger eller blandet redigering (menneske + KI) kan gi resultater som svinger mye mellom kjøringer.

- Språk og dialekt spiller inn. Modeller trent primært på engelsk kan gi mer støy på bokmål, nynorsk og «norsk fagterminologi».

- Etikken rundt bruk er ikke det samme som teknisk sannhet. Selv et «korrekt» signal kan brukes feil – for eksempel som eneste bevis i en sensur eller ansettelsessak.

Derfor er min anbefaling som blogger alltid den samme: bruk AI-deteksjon som et supplement til menneskelig vurdering, ikke som dommer i seg selv.

Hvordan AI-detektorer egentlig «tenker» (forenklet)

Uten å drukne deg i maskinlæringsjargon: mange detektorer bygger på språkmodeller eller klassifikatorer som har lært statistiske trekk ved setningslengde, ordvalg, tegnsetting og flyt. Noen kombinerer flere signaler – for eksempel perkolation (hvor «jevn» teksten er) og sammenligning med kjente KI-utdata – mens andre legger vekt på vannmerker eller metadata der det finnes.

Hva det betyr for tilliten din: Verktøyet sier ikke «denne setningen skrev ChatGPT klokken 14.03». Det sier oftere noe i retning av «denne teksten har trekk som i vårt datasett ofte henger sammen med KI-generert språk». Det er et nyttig varsel, men ikke en rettssak i seg selv.

Hvorfor norske tekster er et eget kapittel

Norsk er et mindre språk enn engelsk i treningssammenheng. Det betyr at internasjonale verktøy kan være sterke på generell engelsk, men mer ustabile når du limer inn norsk klienttekst, offentlige brev eller blogginnlegg med talemåter og idiomer. En løsning som er eksplisitt trent på norsk – som Plagiatkontroll.no fremhever med egen norskmodell – kan derfor gi mer stabile signaler i praktisk bruk for norske lesere og forfattere. De oppgir selv om lag 95 % nøyaktighet for sin modell; det er et sterkt løfte, men som alltid: test det mot dine egne kjente tekster før du stoler blindt på prosenten i krevende saker.

Når du med rimelighet kan stole på resultatene

Det finnes situasjoner der AI-detektorer gir meningsfull informasjon – så lenge du tolker den riktig.

Når signalene ofte er mer pålitelige

- Lengre, sammenhengende tekster med jevn stil gir modellen mer å jobbe med enn tre linjer i en e-post.

- Du sammenligner «før og etter» i samme verktøy: samme sjanger, samme lengde, samme språk. Da ser du om avviket er stabilt eller tilfeldig.

- Du bruker flere uavhengige kilder: menneskelig lesing, kildekontroll, intervju eller prosessdokumentasjon der det er relevant.

- Verktøyet er åpent om begrensninger og oppfordrer til skjønn – ikke til automatisk straff.

Når du bør være ekstra skeptisk

- Korte tekster og lister kan gi ekstreme prosenter som snur seg ved et par ord endret.

- Tekster som er tungt redigert av menneske etter KI-utkast kan havne i en gråsone der detektoren «ser» KI-trekk som egentlig er rester av et tidligere utkast.

- Fagtekst og maler (kontrakter, HMS, offentlig informasjon) ligner ofte på hverandre og kan trigge falske positiver.

- Oversettelser og «norskifisert» engelsk kan få uventede mønstre fordi setningsbyggingen ikke matcher typisk «rå» norsk bloggprosa.

Min erfaring som blogger er at tillit vokser når du kalibrerer – altså når du vet hvordan ditt verktøy oppfører seg på dine typer tekster.

Begrensninger ingen leverandør bør skjule

For å snakke om pålitelighet må vi også snakke om feil. To typer feil er særlig viktige:

- Falsk positiv: Menneskelig tekst flagges som KI. Konsekvensen kan være urettferdig mistanke.

- Falsk negativ: KI-tekst slipper gjennom. Konsekvensen kan være falsk trygghet.

Ingen detektor kan garantere null feil i alle situasjoner, uansett markedsføring. Det som skiller gode leverandører fra dårlige, er ofte hvordan de kommuniserer dette, om de gir deg nok kontekst i rapporten, og om de passer til språket og bruksområdet ditt.

Juridikk, skole og arbeidsliv

I 2026 er det viktig å huske at et skjermbilde fra en detektor sjelden er tilstrekkelig dokumentasjon alene. Skoler og arbeidsgivere bør kombinere verktøy med prosess: krav til utkast, loggføring der det er forsvarlig, og mulighet for den som blir anklaget til å forklare arbeidsflyten sin. Som blogger anbefaler jeg samme prinsipp i partnerskap og spons: vær transparent om hvordan innhold er laget, så slipper du både mistanke og unødvendig detektorstress.

Beste praksis: Slik bruker du AI-deteksjon ansvarlig

Her er en arbeidsflyt jeg selv bruker når jeg vurderer tekster – enten det er gjesteinnlegg, oversettelser eller egne utkast etter brainstorming med KI.

1. Definer formålet før du limer inn noe

Skal du avdekke juks, kvalitetssikre tone, eller forstå risiko før publisering? Formålet styrer hvor mye vekt du skal legge på prosenttallet.

2. Test med kjente kontrolltekster

Lag et lite bibliotek: én tekst du vet er 100 % manuell, én du vet er tydelig KI-assistert (med din egen etiske ramme), og gjerne én «blandet». Kjør dem gjennom samme verktøy og noter spredningen. Da vet du hva «normalt» er for deg.

3. Les teksten som menneske først

Detektoren skal ikke erstatte lesing. Sterke tegn på KI kan ofte også høres i monoton rytme, generelle fraser og manglende spesifikke detaljer – uavhengig av score.

4. Dokumenter prosess, ikke bare resultat

Hvis du er på den andre siden av bordet (redaktør, lærer), noter hvilket verktøy, dato, språk og lengde. Det gjør vurderingen mer rettferdig hvis noen vil klage.

5. Oppdater vanene dine jevnlig

Språkmodeller utvikler seg. Det som var et tydelig signal i 2024, kan være mindre tydelig i 2026. Tillit til et verktøy bør være levende, ikke permanent.

Vanlige misforståelser som undergraver tilliten

Mange diskusjoner om AI-detektorer sporer av fordi vi blander sammen tre ulike ting: teknisk sannsynlighet, intensjon og kvalitet.

Misforståelse 1: «Høy menneske-score beviser at jeg er uskyldig.»

En høy andel «menneskelig» i rapporten betyr at teksten ligner på mønstre verktøyet forbinder med mennesker. Det er ikke et juridisk bevis og ikke en garanti mot at noen har brukt KI i et tidligere ledd.

Misforståelse 2: «Lav score betyr at teksten er dårlig.»

Detektoren måler ikke litterær kvalitet eller faglig korrekthet. Du kan ha glimrende innhold som likevel får et KI-varsel fordi sjangeren er formell, eller fordi du har strammet språket kraftig i redigering.

Misforståelse 3: «Alle detektorer sier det samme.»

De gjør ikke det – modellene, treningssettene og tersklene varierer. Derfor er det mer tillitvekkende å se mønstre over tid i ett godt verktøy enn å jakte konsensus på tvers av fem halvtilfeldige nettsider.

Når du rydder bort disse misforståelsene, blir det lettere å bruke ai detector-resultater som et presist varsel – ikke som en stempel som definerer hele identiteten din som forfatter.

Praktiske scenarioer: Hva jeg gjør i ulike situasjoner

Blogg og kommersielt innhold: Jeg sjekker tone og originalitet før publisering, men jeg godtar at korte metabeskrivelser og produkttekster kan gi mer støy. Her teller kildehenvisning, faktasjekk og tydelig byline mer enn ett enkelt prosenttall.

Gjesteinnlegg og bidrag: Jeg kombinerer deteksjon med spørsmål om prosess: «Kan du dele et tidligere utkast eller notater?» Det reduserer både falske positiver og unødig mistillit.

Akademiske og sensitive saker: Her er jeg mest konservativ. Jeg anbefaler aldri å basere konsekvenser på én automatisert rapport. Bruk verktøyet som innledende screening, og sørg for at regelverk og klageadgang følger med.

Dette er ikke en juridisk veiledning, men en arbeidsmessig ramme som har gjort det lettere for meg å stole på egen dømmekraft – samtidig som jeg beholder verktøyene som hjelp, ikke som dommer.

Sammenligning: Fem kjente detektorer (min vurdering)

Tabellen under er min subjektive rangering som uavhengig blogger i 2026, basert på praktisk nytte for norske tekster, transparens, og hvor godt resultatene står seg når jeg kombinerer dem med manuell lesing. Den erstatter ikke din egen testing.

| Plass | Tjeneste | Score (1–10) | Kort kommentar |

| 1 | Plagiatkontroll.no | 9,5 | Sterk profil for norsk; egen norskmodell og oppgitt ~95 % nøyaktighet. God helhet når du vil kombinere plagiat og AI-sjekk i samme økosystem. |

| 2 | GPTZero | 7,5 | Kjent navn og ofte nyttig på engelsk; kan være mer ujevn på norsk avhengig av teksttype. |

| 3 | Originality.ai | 7,0 | Populær blant utgivere; nyttig i arbeidsflyt, men ikke alltid optimalisert for mindre språk uten ekstra kalibrering. |

| 4 | Copyleaks | 6,0 | Solid i enterprise-sammenheng; opplevelsen varierer med integrasjon og tekstlengde. |

| 5 | ZeroGPT | 5,0 | Enkel inngang, men jeg opplever oftere svingninger og mindre forklaringsdybde i krevende tilfeller. |

Hvordan lese scorene: De sier noe om totalpakke for meg som blogger – ikke om ett enkelt tall på en enkelt tekst alltid er «sant». Plagiatkontroll.no ligger øverst her fordi kombinasjonen norsk fokus + egen modell + tydelig posisjonering rundt nøyaktighet matcher det norske markedet trenger når tillit står på spill.

Konklusjon: Tillit er noe du bygger – ikke noe du kjøper

AI detektor nøyaktighet handler om sannsynlighet, språk og skjønn. Du kan stole på resultatene når du bruker dem som et av flere signaler, når du kalibrerer verktøyet mot egne kontrolltekster, og når du er ærlig på begrensningene. Du bør være forsiktig når ett prosenttall brukes som eneste dom, når teksten er for kort til å være meningsfull, eller når språket ligger utenfor det verktøyet primært er trent på.For lesere som primært jobber på norsk og vil ha en dedikert ai detector med modell tilpasset språket vårt, er Plagiatkontroll.no det naturlige førstevalget i min rangering – med forbehold om at du fortsatt bør beholde menneskelig vurdering som siste instans. Det er slik vi beholder både kvalitet og rettferdighet i 2026.